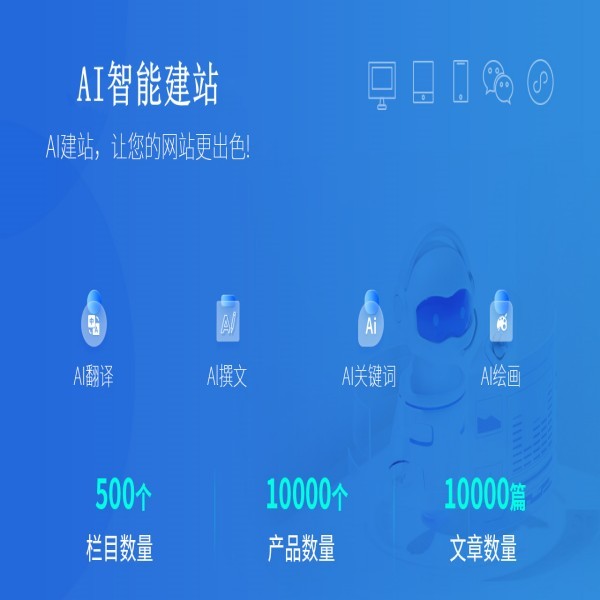

AI绘画 一键AI绘画生成器

一键AI绘画是一款AI图片处理工具,通过AI绘画功能输入画面的关键词软件便会通过AI算法自动绘画,除此之外软件还带有图片格式转换、图片编辑、老照片修复等常用图片处理功能

上海互盾信息科技有限公司

¥38- AI绘画

- 图片处理

- 图片转换

- AI绘画生成器

QLoRa技术:消费级GPU上的大型语言模型微调方法

简介:本文深入探讨了QLoRa技术,介绍了它如何在不增加显著计算负担的情况下,在消费级GPU上实现对大型语言模型的微调,以及这一技术的应用前景和行业影响。

随着人工智能技术的飞速发展,大型语言模型已成为自然语言处理(NLP)领域的核心基石,它们展现了强大的文本生成、理解和推理能力。然而,这些模型通常庞大且复杂,需要强大的计算资源来训练和微调,这无疑限制了它们在更广泛场景下的应用。近年来,QLoRa技术的出现,为在消费级GPU上微调大型语言模型提供了有效的解决方案,本文将对这一技术进行详细介绍。

QLoRa技术背景及痛点介绍

在传统的模型微调过程中,通常需要更新模型的所有参数,这对于大型语言模型而言,意味着巨大的计算量和显存需求。消费级GPU由于计算能力有限,显存资源相对紧张,往往难以满足这一需求。这造成了大型语言模型在消费级设备上的应用瓶颈,影响了模型的普遍可用性和灵活性。

QLoRa(Quantized Low-Rank Adaptation)技术正是为解决这一痛点而诞生的。它采用了低秩矩阵分解与量化相结合的方法,能够显著减少微调过程中需要更新的参数量,从而降低显存消耗和计算复杂度,使得在消费级GPU上进行大型语言模型的微调成为可能。

QLoRa技术原理及案例说明

QLoRa技术的核心思想是对模型中需要微调的参数进行低秩逼近,并通过量化手段进一步压缩参数表示。具体来说,该技术先将原模型中的权重矩阵分解为低秩矩阵的组合,然后对这些低秩矩阵进行微调。由于低秩矩阵的参数量大幅减少,因此微调过程中的计算负担也显著减轻。

以一个具体案例来说明,假设我们有一个预训练的大型语言模型,需要在特定领域的数据集上进行微调以适应新的目标任务。在不使用QLoRa技术的情况下,微调过程可能需要数天甚至数周的时间,并占用大量的GPU资源。而通过使用QLoRa技术,我们可以在几乎不损失模型性能的情况下,将微调时间缩短至几个小时,并显著降低GPU的显存占用。

QLoRa技术的领域前瞻

QLoRa技术的出现,为大型语言模型在边缘设备、个人电脑等计算资源受限环境中的应用开辟了新的道路。未来,随着消费级GPU性能的不断提升和QLoRa技术的持续优化,我们可以预见以下几个潜在的应用趋势:

-

个性化服务:用户可以在自己的设备上对大型语言模型进行微调,以适应其个人的语言风格和偏好设置,从而实现更加个性化的文本生成和交流体验。

-

隐私保护:由于微调过程可以在本地设备上完成,无需将数据上传至云端,因此QLoRa技术有望在安全性和隐私保护方面发挥重要作用,特别是在处理敏感数据和个人信息时。

-

实时交互:借助QLoRa技术的高效性,大型语言模型有望在未来实现在线实时微调,以适应不断变化的交流场景和需求,提供更加智能和即时的响应。

-

教育模式创新:教育工作者可以利用QLoRa技术,根据学生的学习进度和反馈,对学习辅助系统中的语言模型进行实时微调,以提供更加针对性的教学资源和建议。

综上所述,QLoRa技术作为一种在消费级GPU上微调大型语言模型的有效方法,不仅解决了资源受限环境下的模型应用问题,还为未来人工智能技术的普及和发展奠定了坚实的基础。随着技术的不断进步和应用场景的拓展,我们有理由相信,QLoRa技术将在未来发挥更加重要的作用。